ვიდეოების გამოყენება კონტექსტიდან ამოგლეჯილად ყალბი ამბების გავრცელების მიზნით სიახლე არ არის. თუმცა, ბოლოდროინდელი შეშფოთება დეზინფორმაციის თემაზე უკავშირდება deepfake-ს – მანიპულაციურ ვიდეოს, რომელიც ხელოვნური ინტელექტის საშუალებით არის შექმნილი.

Deep fake -ს შეუძლია შექმნას შთაბეჭდილება, თითქოს ვინმემ ისეთი რამ გააკეთა ან თქვა, რაც სინამდვილეში არ მომხდარა, მაგალითად, ობამა პრეზიდენტ ტრამპს შეურაცხყოფას აყენებს ან მარკ ზუკერბერგი აღფრთოვანებულია ძალაუფლებით, რომელიც მოპარული მონაცემებიდან მიიღო. ორივე ვიდეოში ტუჩების სინქრინიზაციის ტექნოლოგიით პაროდისტის ვიდეო ან ხმა ობამას/ზუკერბერგის რეალურ კადრებთან არის თანხვედრაში. შედეგი კი გასაოცრად რეალურად გამოიყურება.

რამდენიმე წლის წინ მხოლოდ ჰოლივუდის სტუდიებს და დიდ ვიზუალურ ეფექტზე მომუშავე კომპანიებს შეეძლოთ, მათი სურვილის მიხედვით ვიდეო მანიპულაციები წარმატებულად განეხორციელებინათ, თუმცა, ამისათვის მილიონობით დოლარის ინვესტიციას ახორციელებდნენ. ძალიან მალე ტექნოლოგია ალტერნატიული ციფრული ვიდეოების დასამზადებლად უკვე ყველასათვის ხელმისაწვდომი გახდა. ისეთი ყალბი ვიდეოს შექმნა, რომელიც ძალზედ ჰგავს რეალურს, კომპიუტერული ტექნოლოგიების განვითარებამ მარტივი გახადა და მის შესაქმნელად საჭირო, ანონუმური წყაროს კოდი ყველასათვის ღიად ხელმისაწვდომია. წარმოიდგინეთ, რომ შეიქმნა ყალბი ვიდეო, სადაც მსოფლიოს ლიდერი ომს აცხადებს. ბერკლისა და სამხრეთ კალიფორნიის უნივერსიტეტის მკვლევრები deepfake-ის ტექნოლოგიის შესახებ გვაფრთხილებენ: “ ჩვენი დემოკრატიისთვის, ეროვნული უსაფრთხოებისა და საზოგადოებისთვის deepfake წარმოადგენს მნიშვნელოვან საფრთხეს”. ექსპერტებს განსაკუთრებულად აშფოთებთ აშშ-ს 2020 წლის არჩევნებზე deepfakes-ის შესაძლო გავლენა.

ამ დრომდე ყველაზე ცნობილი deepfake, რომელიც ინტერნეტ სივრცეში გავრცელდა გართობის მიზნით შეიქმნა და მასში ნიკოლას ქეიჯი სხვადასხვა ფილმებში ჩნდება, ვიდეოში მსახიობის სახე სხვადახვა კადრებშია ჩასმული. ამ deepfake-ის უკან მდგარი ალგორითმი დიდი მონაცემების (სურათების, ვიდეოების) დამუშავების საფუძველზე არის მიღებული. რაც უფრო განსხვავებულია ეს მონაცემები განათებისა და ემოციების გამოხატვის კუთხით, მით უკეთესი.

კომპანია Deeptrace-ის უახლესი კვლევის მიხედვით, ინტერნეტში 15,000 deepfake ვიდეოა განთავსებული, მათი 96% კი პორნოგრაფიულია. Deepfake-თან დაკავშირებული ერთ-ერთი რისკი ამ ტექნოლოგიის “პორნო შურისძიების” მიზნით გამოყენებაა: არსებულ პორნოგრაფიულ ვიდეოში პიროვნების სახის ჩასმა deepfake-ს დისკრედიტიისა და შანტაჟის საშუალებად აქცევს. ცნობილი ადამიანები, მაგალითად, ემა უოტსონი და სკარლეტ იოჰანსონი deepfake-პორნოგრაფიის მსხვერპლები უკვე გახდნენ.

ფოტოები და ვიდეოები მანიპულაციის საშუალებებად მათი არსებობის დღიდან გამოიყენება. deepfake შესაძლოა ცრუ ინფორმაციის გასავრცელებლად იქნეს გამოყენებული, რაც დეზინფორმაციულ კამპანიებს ბევრად სახიფათოს გახდის. რას შეიძლება ეს ნიშნავდეს იმ ქვეყნებისათვის, რომლებსაც ყოველდღიურად უწევთ ყალბ ინფორმაციასთან გამკლავება? მაგალითად განვიხილოთ საქართევლო, ქვეყანა პოლარიზებული პოლიტიკური სისტემით. აქ პოლიტიკოსები დეზინფორმაციას უსაფრთხოების საკითხად განიხილავენ: “ პროპაგანდას უცხო ქვეყნები ჩვენს შიდა პოლიტიკაზე გავლენის მოსახდენად იყენებენ,”- თქვა ნინო გოგუაძემ, საქართველოს პარლამენტის საგარეო ურთიერთობათა კომიტეტის ყოფილმა წევრმა. დეზინფორმაცია ფართოდ არის გავრცელებული, ის არა მხოლოდ რუსეთიდან, არამედ ქვეყნის შიგნიდანაც მოდის.

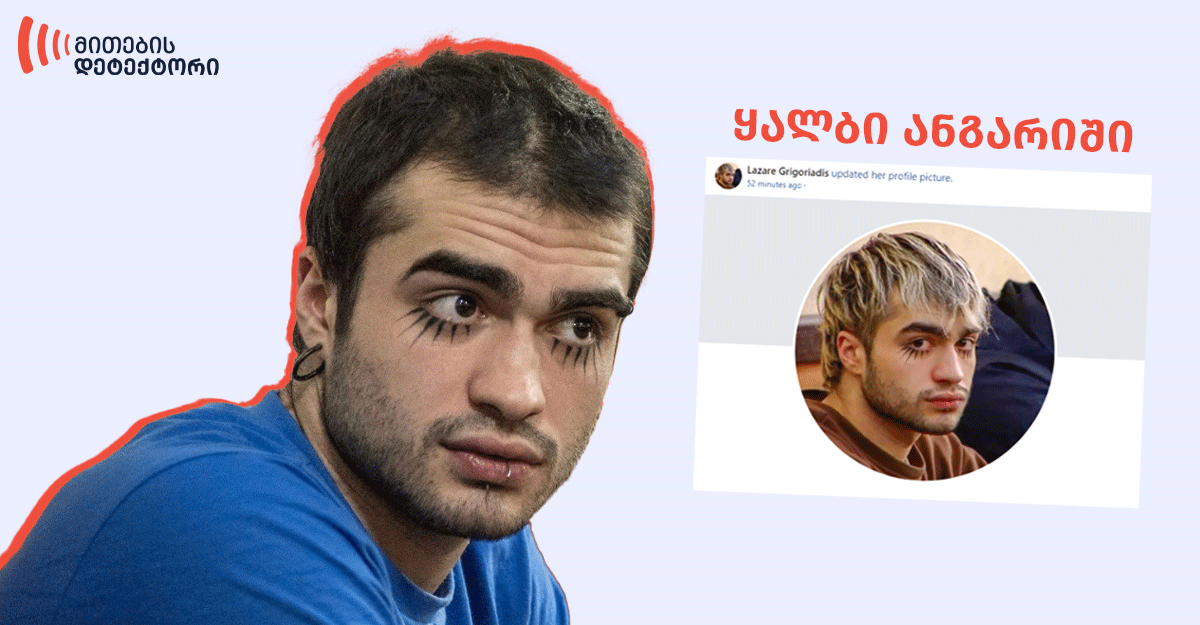

ქართული ფაქტების გადამოწმების ვებ-პლატფორმის, მითების დეტექტორის უახლესი კვლევის მიხედვით, სახელისუფლებო ბლოგერი გიორგი აღაპაშვილი (გიორგი აღაპაშვილის ბლოგი), რომელიც ღიად უპირისპირდებოდა ქართული ოცნების, მმართველი პარტიის, ოპონენტებს, რეალური ადამიანის ნაცვლად ხელოვნური ინტელექტის საშუალებით შექმნილი ფოტო აღმოჩნდა, რაც მზარდი საშინაო პროპაგანდის პრობლემაზე მიუთითებს.

ნამდვილად ნიშნავს თუ არა deepfake საქართველოში უფრო სახიფათო დეზინფორმაციულ კამპანიას? “აქ იაფფასიანი პროპაგანდის წარმოება მარტივია, ამიტომ deepfake-ის ფართოდ გამოყენების საჭიროება არ არსებობს,” – თქვა სოფო გელავამ, მედიის განვითარების ფონდის მკვლევარმა და რედაქტორმა. პრობლემა ის არის, რომ ერთი და იგივე ნარატივი მრავალჯერ მეორდება. შესაძლოა, ყველამ არ დასვას კითხვები ახალი ამბის შესახებ, რომელსაც ინტერნეტში გადააწყდება. t.

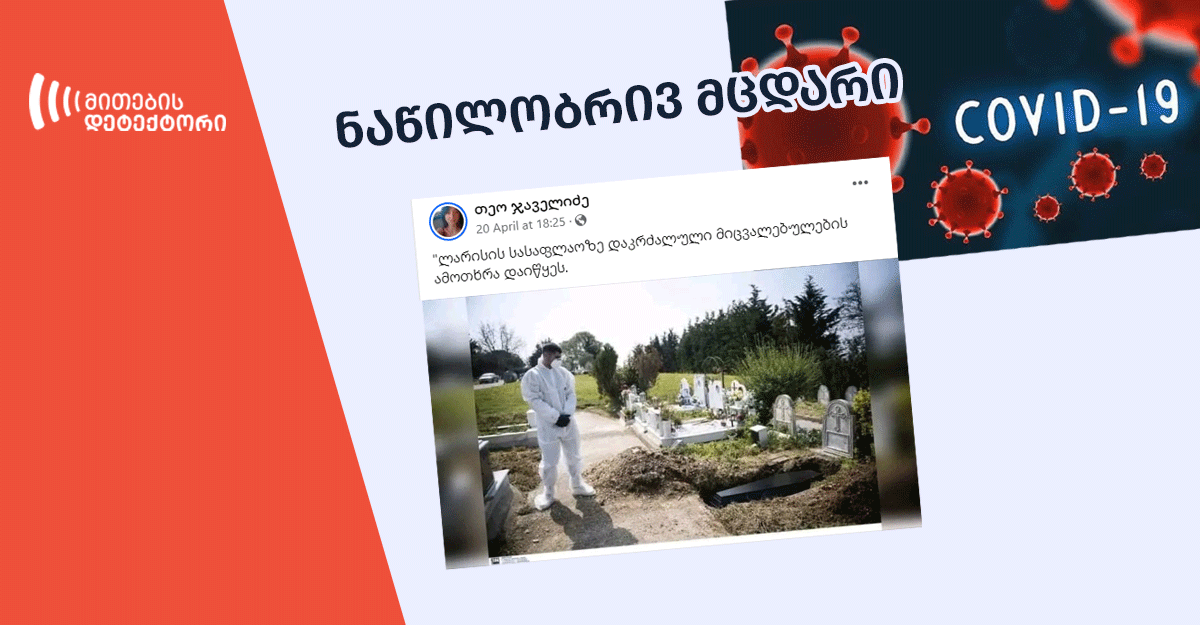

თამარ კინწურაშვილის, ქართული არასამთავრობო ორგანიზაციის მედიის განვითარების ფონდის დირექტორის, თქმით, საქართველოში დეზინფორმაციის მთავარი სტრატეგია შიშის გავრცელებაა, რისი მაგალითიცაა ნატოში გაწევრიანების შემთხვევაში ომის ან ტერირტორიების დაკარგვის შესახებ განცხადებები. თუმცა, ყალბი ამბები არც ისე დახვეწილად არის შექმნილი. ცრუ ონლიან მედია გამოცემები ისეთი დასავლური მედიის დომეინების სახელწოდებებს “იპარავენ”, როგორიცაა “Guardian” , i-ს თავზე წერტილის გამოტოვებით თუ დაბოლოების – “.com”-ის “.ge”-ად გადაკეთებით. ფოტოები უბრალოდ არასწორ, შეცდომაში შემყვან კონტექსტშია გამოყენებული და რეალობისაგან აბსოლუტურად განსხვავებულ ამბავს გვიყვება. სატირული და იუმორისტული სტატიები ინგლისურენოვანი მედიიდან რეალურ ისტორიებად არის წარმოჩენილი, მაგალითად, “ამერიკაში, მუზეუმის თანამშრომელი ობამას და სხვათა ცვილის ფიგურების გაუპატიურების გამო დააკავეს” ან ძლიერი ნარკოტიკული საშუალების ზემოქმედების ქვეშ მყოფმა ძიძამ სამი თვის ჩვილის შეჭმა გადაწყვიტა“. ამ ცრუ ინფორმციების გავრცელების მიზანი ზოოფილიისა და ნეკროფილიის დასავლურ ქვეყნებში მიღებულ პრაქტიკად წარმოჩენაა იმისათვის, რომ გავრცელდეს ნარატივი, თითქოს მჭიდრო კავშირები ისეთ ქვეყნებთან, როგორიცაა აშშ, საფრთხეს უქმნის ქართულ ღირებულებებსა და იდენტობას.

ეროვნულ დემოკრატიული ინსტიტუტის (NDI) თანახმად, “კარგად გავრცელებული დეზინფორმაციისა და ანტი-დასავლური პროპაგანდისტული კამპანიის ბევრი მითი და გზავნილი მოსახლეობის პასუხებში”1 საზოგადოებრივი აზრის კვლევების დროს აისახება. საქართველოს ეს მაგალითი აჩვენებს, რომ დეზინფორმაციის პრობლემა არ უკავშირედება იმას, თუ რამდენად დახვეწილია ის ვიზუალურად, არამედ რამდენად ეფექტიანია. დეზინფორმაციისა და ყალბი ამბების გასავრცელებლად ხელოვნური ინტელექტისა და სრულყოფილად მანიპულაციური ვიდეოს გმოყენების საჭიროება არ არსებობს. ბოლოს და ბოლოს შეიძლება არსებობდნენ ადამიანები, რომლებიც ცრუ ინფორმაციას მაინც დაიჯერებენ, მიუხედავად იმისა, რომ ის არ წაროადგენს deepfake -ის უახლესი ტექნოლოგიით შექმნილ სრულყოფილად დამუშავებულ ვიდეოს. დიდი პრობლემა არის ის, რომ ყალბი ამბები ხშირად სოციალური ქსელების, მაგალითად ფეისბუკის, საშუალებით ვრცელდება.

განსაკუთრებით ჟურნალისტებმა უნდა გაიაზრონ, რომ მალე სრულყოფილი ვიდეო მანიპულაციები ყველასათვის ხელმისაწვდომი იქნება, მათთვისაც კი, ვისაც კომპიუტერული კოდების დაწერა არ შეუძლია. მედიაწიგნიერების პროგრამების საშუალებით ცნობიერების ამაღლება მნიშვნელოვანი ნაბიჯია საზოგადოების განათლებისთვის, თუმცა, საზოგადოება პანიკაში არ უნდა ჩავარდეს, თითქოს ყველა ვიდეო, რომელსაც ვხედავთ, ყალბია. deepfake-ის ნამდვილი საფრთხე შესაძლოა, სრულიად არ იყოს თავად ყალბი ვიდეო, არამედ ის, რომ მოსახლეობამ ეჭვი საკუთარ რეალობაში შეიტანოს.

Deutsche Welle- ის რეპორტიორი სპეციალურად “მითების დეტექტორისთვის”

სტატია პროექტის #FIGHTFAKE-ის ფარგლებში მომზადდა, რომელსაც MDF-ი მის პარტნიორ ორგანიზაცია Deutsche Gesellschaft e.V.-თან ერთად ახორციელებს.

____________________________

1ეროვნულ დემოკრატიული ინსტიტუტი (NDI): საზოგადოებრივი აზრის კვლევა; საგარეო პოლიტიკა, უსაფრთხოება და დეზინფორმაცია საქართველოში, მარტი 2018